Ликбез по SEO аналитике. Полезные сервисы

Мы постоянно имеем дело с информацией — запросы, показы, клики и т.д. и т.п. Многие оптимизаторы заимствуют метрики и не вникают в суть данных. Этот подход, безусловно, прост и быстр. Но при этом малоэффективен, поскольку пользоваться минимальным набором традиционных метрик — значит лишить себя кучи полезных выводов.

По сути, аналитика сводится к сбору и анализу данных. Здорово, если масштаб компании позволяет собирать данные решениями своей команды разработчиков. Если нет — вам наверняка будут интересны простые и доступные инструменты. Опишем некоторые из них:

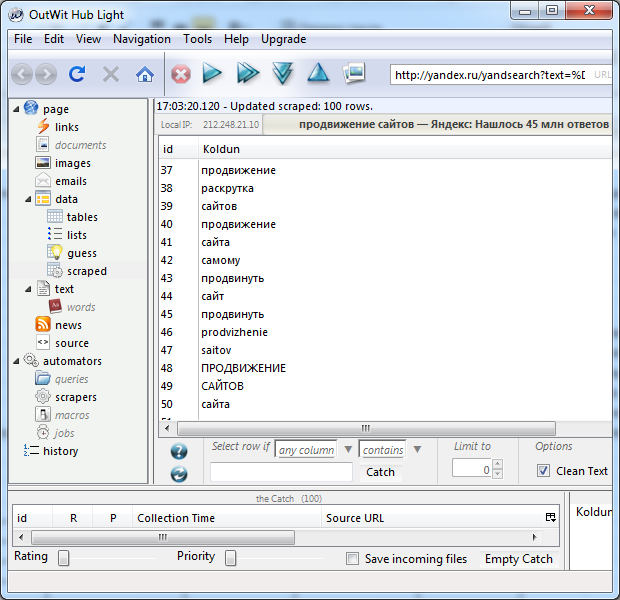

— фантастически удобный плагин к FireFox для извлечения структурированных данных из веб-контента. Плагин умеет извлекать данные самостоятельно, либо по предопределенному шаблону. Можно использовать регулярные выражения и листать страницы. Например, вот результат парсинга страницы выдачи Яндекса по запросу «продвижение сайтов» с извлечением переколдовок:

Версия Outwit Pro позволяет создавать процессы и макросы и, однозначно, стоит 30 долларов, что за нее просят. Но и бесплатная Light-версия весьма полезна.

предоставляет много возможностей для повышения эффективности поискового продвижения. Самые очевидные применения:

- Оценка стоимости конверсии в срезах по запросам и по источникам трафика позволяет сосредоточить усилия на действительно полезных запросах, отбросив конкурентные, но малоэффективные (достаточно штатных возможностей Google Analytics).

- Выгрузка ключевых слов, по которым были зафиксированы переходы из органического поиска с дальнейшей проверкой частотностей этих запросов и текущих позиций сайта. Этот способ позволяет быстро выявить наилучшие точки приложения усилий оптимизатора. Для массовой обработки ключевых слов «на коленке» удобен .

При выгрузке ключевых слов из Google Analytics максимальный объем csv-файла ограничен 500-ми запросами. Сократить рутину можно, как минимум, двумя способами:

- Если при построении нужного отчета в Google Analytics добавить к url параметр &limit=50000, выгрузка по ссылке «csv» магическим образом будет расширена до 50000 запросов.

- У Google Analytics есть API, которое можно использовать для получения данных. Вот .

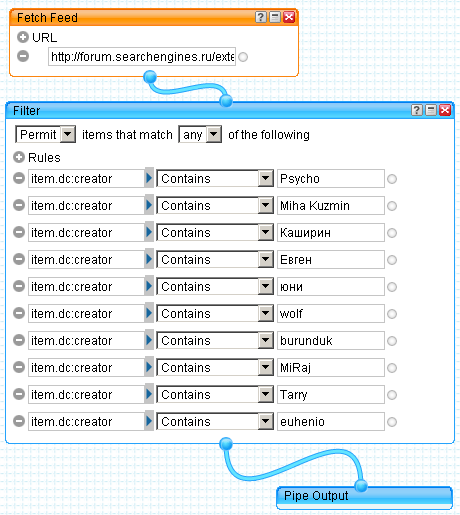

— любопытный инструмент для небольших задач автоматизации сбора и обработки данных. Например, мы хотим отслеживать посты на Searchengines.ru, созданные авторитетными SEO-специалистами. В Yahoo Pipes это делается запросто, берем RSS-фид и фильтруем его по полю «автор» (item.dc:creator):

Результат доступен в виде RSS-фида или уведомлений . Просто и удобно. .

Скажу несколько слов о регулярных выражениях. Для SEOшников, не имеющих опыта веб-разработки или программирования это может быть серьезным «белым пятном». Суть регулярных выражений — в компактной и чрезвычайно мощной процедуре поиска (и замены) в текстах. Существует несколько реализаций, но общие идеи неизменны. Многие продвинутые текстовые редакторы (например, , ) позволяют использовать регулярные выражения и это, поистине, бесценно.

Разумеется, собранные данные нужно хранить в легкодоступной для обработки форме. Если данных немного — Excel в помощь. Стандартные фильтры и сортировки, плюс функции «счетесли», «суммесли», «впр» и использование табличных формул (формул массива, Ctrl-Shift-Enter) закроют основные потребности в выборке данных. Для больших объемов данных стоит использовать базы данных (MySQL, PostgreSQL и т.д.). SQL несложен и эффективен.

Есть о чем рассказать? Тогда присылайте свои материалы Марине Ибушевой

-

Михаил Сливинский больше года назадЭто не беда. Просто смените расширение файла на txt откройте документ Excel'ем. При открытии будет предложено выбрать кодировку ;)

Михаил Сливинский больше года назадЭто не беда. Просто смените расширение файла на txt откройте документ Excel'ем. При открытии будет предложено выбрать кодировку ;) -

Гость больше года назад

Гость больше года назад

Да, вы правы, все проверил, работает, одна беда - получил кривую кодировку... :) -

Михаил Сливинский больше года назадMurz, да, все просто. Мы ведь говорим о простых общедоступных инструментах ;) Спасибо за Ваш пример!

Михаил Сливинский больше года назадMurz, да, все просто. Мы ведь говорим о простых общедоступных инструментах ;) Спасибо за Ваш пример!

Иван, GA визуально и не должен реагировать на доп. параметр. Т.е. после того, как Вы модифицировали url и нажали enter, страница перегрузится и можно делать выгрузку в csv. При этом вид страницы не изменится. Пробуйте, метод гарантированно работает. -

Иван больше года назадЧто то не выходит с выгрузкой, во первых GA никак не реагирует на дополнительный параметр в url и вообще параметр количества строк таблицы в url никак не отражается.

Иван больше года назадЧто то не выходит с выгрузкой, во первых GA никак не реагирует на дополнительный параметр в url и вообще параметр количества строк таблицы в url никак не отражается. -

Murz больше года назадА... всё так просто ;) Я думал он там какие-то более хитрые данные собирает, группирует.

Murz больше года назадА... всё так просто ;) Я думал он там какие-то более хитрые данные собирает, группирует.

А так для поиска жирностей можно использовать xpath и расширение Xpath Checker.

Для яндекса например - открываем страницу, правой кнопкой на жирное слово, view xpath и получаем xpath:

id('js')/x:body/x:div[3]/x:div/x:div[2]/x:div/x:div[2]/x:ol/x:li[3]/x:h2/x:a/x:b[1]

Вырезаем оттуда лишнее:

id('js')/x:body/x:div[3]/x:div/x:div[2]/x:div//x:b...А... всё так просто ;) Я думал он там какие-то более хитрые данные собирает, группирует.

А так для поиска жирностей можно использовать xpath и расширение Xpath Checker.

Для яндекса например - открываем страницу, правой кнопкой на жирное слово, view xpath и получаем xpath:

id('js')/x:body/x:div[3]/x:div/x:div[2]/x:div/x:div[2]/x:ol/x:li[3]/x:h2/x:a/x:b[1]

Вырезаем оттуда лишнее:

id('js')/x:body/x:div[3]/x:div/x:div[2]/x:div//x:b

и получаем список колдунства ;) -

Михаил Сливинский больше года назадdimok, точно :)

Михаил Сливинский больше года назадdimok, точно :)

Denis, я не стремился рассказать про общеизвестные инструменты. Я описал некоторые малоизвестные, но эффективные инструменты. Будет время - продолжу ;) -

Murz больше года назадЧто-то непонятно как с помощью OutWit удалось вытащить переколдовки со страницы. Нужен какой-то скрипт для этого задать? Можно поподробнее, с примерами, как с помощью OutWit извлекать полезные данные со страницы?

Murz больше года назадЧто-то непонятно как с помощью OutWit удалось вытащить переколдовки со страницы. Нужен какой-то скрипт для этого задать? Можно поподробнее, с примерами, как с помощью OutWit извлекать полезные данные со страницы? -

Михаил Юрьевич больше года назадПрисоединяюсь к Murz с тем же вопросом, но если есть возможность поделиться "секретом Полишинеля" :)) поподробнее о OutWit.

Михаил Юрьевич больше года назадПрисоединяюсь к Murz с тем же вопросом, но если есть возможность поделиться "секретом Полишинеля" :)) поподробнее о OutWit.

Просим! просим! просим!.. -

Михаил Сливинский больше года назад[CODE]Ок, давайте на примере "продвижения сайтов" и рассмотрим пошагово:

Михаил Сливинский больше года назад[CODE]Ок, давайте на примере "продвижения сайтов" и рассмотрим пошагово:

1. Запрос в ya.ru "продвижение сайтов".

2. Кликаем на иконку OutWit.

3. В левом меню выбираем "scrapers".

4. Смотрим на html код выдачи и понимаем, что переколдовки и термины запроса выделены тегом <b></b>.

5. Создаем один пункт с параметрами "description"="key", "marker before" = "<b>", "mark...[CODE]Ок, давайте на примере "продвижения сайтов" и рассмотрим пошагово:

1. Запрос в ya.ru "продвижение сайтов".

2. Кликаем на иконку OutWit.

3. В левом меню выбираем "scrapers".

4. Смотрим на html код выдачи и понимаем, что переколдовки и термины запроса выделены тегом <b></b>.

5. Создаем один пункт с параметрами "description"="key", "marker before" = "<b>", "marker after" = "</b>" и отмечаем чекбокс "ok".

6. Сохраняем scraper ("save").

7. Выбираем сохраненный scraper и жмем кнопку "execute".

8. Вуаля :)[/CODE] -

Denis больше года назадС таким громким названием поста всего лишь три инструмента. Чувствую, что меня где-то обманули ))

Denis больше года назадС таким громким названием поста всего лишь три инструмента. Чувствую, что меня где-то обманули ))